3.3 Випадкові сигнали та їх характеристики

Для опису випадкових процесів використовують методи теорії ймовірностей. У загальному випадку повною характеристикою випадкового процесу є його багатовимірна щільність імовірностей. Для стаціонарних гаусівських процесів одновимірна щільність імовірностей визначається дисперсією випадкового процесу. Для опису гаусівських процесів достатніми характеристиками є й кореляційна функція процесу. Однієї з характеристик випадкового сигналу є його спектральна щільність потужності, пов'язана з кореляційною функцією узагальненим перетворенням Фур'є.

Спектр випадкового процесу є суцільним. Для випадкових процесів з постійною спектральною щільністю й нескінченною смугою частот потужність нескінченна, а кореляційна функція є дельта-функцією. Такий процес має нескінченну дисперсію, є некорельованим і називається білим шумом. У випадкового процесу з постійною спектральною щільністю в обмеженій смузі частот потужність є скінченною і її можна визначити.

Отож, розглянемо дане питання більш детально. Під випадковим (стохастичним) процесом розуміють таку випадкову функцію часу ![]() , значення якої в кожен момент часу випадкові. Конкретний вигляд випадкового процесу, зареєстрованого у деякому досліді, називають реалізацією випадкового процесу. Дані, які характеризують всю множину можливих реалізацій називаються ансамблем.

, значення якої в кожен момент часу випадкові. Конкретний вигляд випадкового процесу, зареєстрованого у деякому досліді, називають реалізацією випадкового процесу. Дані, які характеризують всю множину можливих реалізацій називаються ансамблем.

Основними ознаками, за якими класифікують випадкові процеси є: простір станів, часовий параметр та статичні залежності між випадковими величинами ![]() в різні моменти часу

в різні моменти часу ![]() .

.

Простором станів (англ. space of states) називають множину можливих значень випадкової величини ![]() . Випадковий процес у якому множини станів складають континуум, а зміна станів можлива в будь-які моменти часу, називають неперервним випадковим процесом. Якщо зміна станів допускається лише в кінцевому чи поточному числі моментів часу, то говорять про неперервну випадкову величину.

. Випадковий процес у якому множини станів складають континуум, а зміна станів можлива в будь-які моменти часу, називають неперервним випадковим процесом. Якщо зміна станів допускається лише в кінцевому чи поточному числі моментів часу, то говорять про неперервну випадкову величину.

Відповідно до визначення випадковий процес ![]() може бути описаний системою

може бути описаний системою ![]() звичайно залежних випадкових величин

звичайно залежних випадкових величин ![]() , взятих в різні моменти часу

, взятих в різні моменти часу ![]() . При необмеженому збільшенні числа

. При необмеженому збільшенні числа ![]() така система еквівалентна випадковому процесу, що розглядається.

така система еквівалентна випадковому процесу, що розглядається.

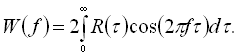

В більшості випадків для характеристики випадкових процесів використовують моментні функції перших двох порядків: математичне сподівання, дисперсію, а також кореляційну функцію

,

,

де ![]() – одновимірна щільність імовірності або одновимірна функція розподілення випадкового процесу. Фізико-математичне сподівання виражає значення сукупності вибірок випадкового процесу у визначений момент часу

– одновимірна щільність імовірності або одновимірна функція розподілення випадкового процесу. Фізико-математичне сподівання виражає значення сукупності вибірок випадкового процесу у визначений момент часу ![]() .

.

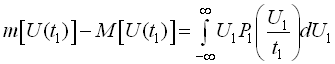

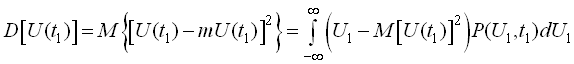

Дисперсія – це математичне сподівання квадрата відхилення величини ![]() від математичного сподівання у визначений момент часу

від математичного сподівання у визначений момент часу ![]() .

.

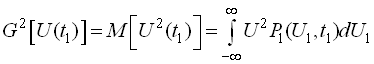

Дисперсія виражається формулою

.

.

Вона виражає розкид значення випадкової величини навколо математичного сподівання. Корінь квадратний з дисперсії прийнято називати середнім квадратичним відхиленням випадкової величини

.

.

Фізично початковий момент другого порядку є повною середньою потужністю випадкової величини.

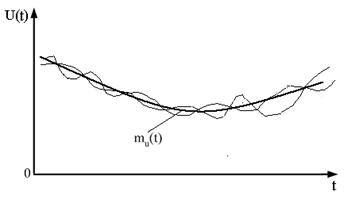

Випадкові процеси можуть мати однакові математичні сподівання й дисперсію, але різко відрізняються за швидкістю зміни своїх значень у часі рис 3.14.

Рисунок 3.14 – Математичне сподівання для різних процесів

Тому для оцінювання ступеня статичної залежності миттєвих значень процесу ![]() в будь-які моменти часу

в будь-які моменти часу ![]() та

та ![]() використовується випадкова функція аргументів

використовується випадкова функція аргументів ![]() , яка називається автокореляційною або просто кореляційною функцією.

, яка називається автокореляційною або просто кореляційною функцією.

При конкретних аргументах ![]() та

та ![]() вона дорівнює кореляційному моменту значень процесу

вона дорівнює кореляційному моменту значень процесу ![]() та

та ![]()

![]() .

.

Двовимірним законом розподілу випадкової функції ![]() називається закон розподілу

називається закон розподілу ![]() системи двох випадкових розмірів

системи двох випадкових розмірів ![]() та

та ![]() , що є значеннями випадкової функції для різних значень аргументів

, що є значеннями випадкової функції для різних значень аргументів ![]() та

та ![]() .

.

Математичним сподіванням випадкової функції ![]() називається невипадкова функція

називається невипадкова функція ![]() , яка при кожному даному значенні аргументу дорівнює математичному сподіванню значення випадкової функції при тому ж значенні аргументу

, яка при кожному даному значенні аргументу дорівнює математичному сподіванню значення випадкової функції при тому ж значенні аргументу ![]() .

.

Кореляційною функцією випадкової функції ![]() називається невипадкова функція двох аргументів

називається невипадкова функція двох аргументів ![]() , яка при кожній парі значень

, яка при кожній парі значень ![]() та

та ![]() дорівнює кореляційному моменту відповідних значень випадкової функції

дорівнює кореляційному моменту відповідних значень випадкової функції

![]() ,

,

де ![]() – центрована випадкова функція.

– центрована випадкова функція.

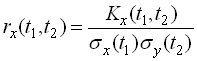

При ![]() кореляційна функція

кореляційна функція ![]() перетворюється в дисперсію випадкової функції

перетворюється в дисперсію випадкової функції ![]() , тобто

, тобто

![]() .

.

Нормованою кореляційною функцією випадкової функції ![]() називається функція

називається функція

.

.

Взаємною кореляційною функцією двох випадкових функцій ![]() та

та ![]() називається функція двох аргументів

називається функція двох аргументів ![]() , яка при кожній довільно обраній парі їх значень дорівнює кореляційному моменту відповідних значень

, яка при кожній довільно обраній парі їх значень дорівнює кореляційному моменту відповідних значень ![]() та

та ![]() цих випадкових функцій

цих випадкових функцій

![]() .

.

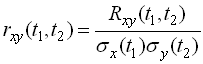

Нормованою взаємною кореляційною функцією двох випадкових функцій ![]() та

та ![]() називається функція

називається функція

.

.

Випадкові функції ![]() та

та ![]() називаються некаліброваними, якщо

називаються некаліброваними, якщо ![]() .

.

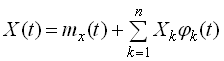

Канонічним розкладанням випадкової функції ![]() називається подання її у вигляді

називається подання її у вигляді

,

,

де ![]() ,

, ![]() – центрована некорельована випадкова величина з дисперсією

– центрована некорельована випадкова величина з дисперсією ![]() ;

; ![]() – невипадкова функція.

– невипадкова функція.

Форми сигналів

За формою сигнали поділяються на неперервні та дискретні.

Неперервні сигнали можуть приймати неперервну множину значень (континуум) в певному інтервалі (в часі і за рівнем).

Дискретні сигнали описуються за допомогою кінцевого набору чисел або дискретних значень певної функції.

Тобто, неперервні сигнали (рис. 3.15, а) зображуються функцією, безперервною в часі на відрізку спостереження ![]() , а дискретні (рис. 3.15, б) поступають тільки в певні моменти часу та зображаються дискретною функцією

, а дискретні (рис. 3.15, б) поступають тільки в певні моменти часу та зображаються дискретною функцією ![]() .

.

Рисунок 3.15 – Неперервні та дискретні сигнали

До елементарних детермінованих сигналів належить зокрема і одинична функція (стрибок).

При вивченні властивостей каналів передачі інформації, сигналів та завад абстрагуються від їх конкретної фізичної природи та призначення і оперують з їх моделями. Модель (англ. model) – це є вибраний спосіб опису об’єкта, процесу або явища, який відображає суттєві з погляду розв’язання даної задачі фактори. Оцінка електронних систем потребує виявлення кількісних співвідношень між основними параметрами джерела інформації і системи, тому дослідження здійснюється на математичних моделях.

Як відомо, інформація міститься в повідомленнях, зміст яких наперед невідомий і джерело інформації видає їх з певною ймовірністю. Передбачити точно зміну інформаційного параметра неможливо. Це означає, що інформаційний сигнал принципово являє собою випадкове коливання і його аналітичною моделлю може бути лише випадковий процес, який визначається імовірнісними характеристиками. Детерміноване коливання (сигнал) відображає відоме повідомлення, і немає сенсу його передавати. Йому відповідає модель у вигляді функції, що повністю визначена в часі. Разом з тим, вивчення моделей детермінованих сигналів дозволяє робити аналіз більш складних випадкових сигналів.

Сукупність детермінованих сигналів може подавати випадковий процес.

Навіть при експериментальному аналізі досить доречно вводити допоміжні функції (рис. 3.16).

Рисунок 3.16 – Формування реалізацій ![]() випадкових функцій

випадкових функцій ![]() з реалізації

з реалізації ![]() випадкового процесу

випадкового процесу ![]()

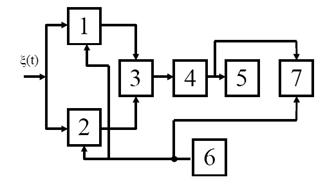

Існуючі аналізатори законів розподілу дозволяють визначати емпіричні функції розподілу та гістограми досліджуваних випадкових процесів. Блок-схема аналізатора наведена на рис. 3.17.

Рисунок 3.17 – Блок-схема аналізатора законів розподілу

Блок-схема складається з таких блоків:

1 – амплітудний селектор (компаратор) з порогом ![]() ;

;

2 – амплітудний селектор (компаратор) з порогом![]() ;

;

3 – пристрій віднімання;

4 – пристрій усереднення;

5 – індикатор;

6 – генератор пилкоподібної напруги;

7 – осцилограф.

Аналіз законів розподілу здійснюється, наприклад, для таких випадкових процесів як гаусів шум, синусоїдальний і пилкоподібний сигнал з випадковими фазами, адитивної суміші корисного сигналу та завади.

Спектральне подання випадкових сигналів

Розглянемо спектральне подання стаціонарних випадкових процесів. Стаціонарні випадкові процеси – це процеси, що протікають у часі однорідно, мають вигляд неперервних випадкових коливань навколо середнього значення ![]() .

.

Якщо математичне сподівання, дисперсія, середнє квадратичне відхилення та кореляція є постійними, то такі процеси – стаціонарні.

Якщо існують випадкові процеси, що не витримують таких умов, але на деякому певному інтервалі відхиленням даних параметрів від константи можна знехтувати, то такий процес називають квазістаціонарним.

В будь-якій динамічній системі випадковий процес починається з так званого “перехідного” процесу і потім переходить в установлений режим, який з деяким наближенням можна вважати стаціонарним. Потрібно сказати, що стаціонарні випадкові процеси неперервні в часі, а значить не мають ні початку, ні кінця. Відомо два поняття: стаціонарність в обмеженому розумінні і стаціонарність у широкому.

Під стаціонарними процесами у вузькому смислі розуміють випадкові процеси, для яких функції розподілу щільності імовірності ![]() вільного порядку

вільного порядку ![]() не змінюються при будь-якому зсуві всієї групи точок

не змінюються при будь-якому зсуві всієї групи точок ![]() повздовж осі часу

повздовж осі часу

![]() .

.

З наведеного визначення можна сказати, що для стаціонарних процесів:

а) одновимірна функція розподілу щільності імовірності не залежить від часу

![]() ;

;

б) двовимірна функція розподілу щільності імовірності залежить тільки від різниці часу ![]()

![]() ;

;

в) тривимірна функція розподілу щільності імовірності залежить тільки від двох різниць часу ![]() та

та ![]()

![]() .

.

Оскільки математичне сподівання і дисперсія виражаються через одновимірну функцію розподілу щільності імовірності, то для стаціонарного процесу математичне сподівання й дисперсія не залежать від часу. Унаслідок залежності двовимірної функції розподілу тільки від різниці часу ![]() , кореляційна функція стаціонарного процесу також залежить тільки від різниці часу

, кореляційна функція стаціонарного процесу також залежить тільки від різниці часу ![]() .

.

Стаціонарною випадковою функцією в широкому смислі називається така випадкова функція ![]() , математичне сподівання якої постійне, а кореляційна функція залежить тільки від різниці аргументів, тобто

, математичне сподівання якої постійне, а кореляційна функція залежить тільки від різниці аргументів, тобто

![]() ,

, ![]() ,

,

де ![]() .

.

Дисперсія стаціонарної випадкової функції постійна

![]() .

.

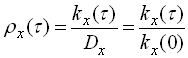

Нормована кореляційна функція ![]() стаціонарної випадкової функції

стаціонарної випадкової функції ![]() має вигляд

має вигляд

.

.

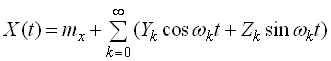

Спектральне розкладання

,

,

де ![]() ,

, ![]() – центровані некорельовані випадкові розміри.

– центровані некорельовані випадкові розміри.

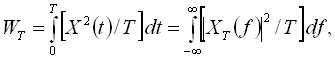

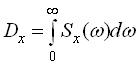

Спектри потужності випадкових функцій визначаються аналогічно спектрам потужності детермінованих сигналів. Середня потужність випадкового процесу ![]() , зареєстрованого в процесі однієї реалізації на інтервалі 0 -

, зареєстрованого в процесі однієї реалізації на інтервалі 0 - ![]() з використанням рівності Парсеваля може бути обчислена за формулою:

з використанням рівності Парсеваля може бути обчислена за формулою:

де ![]() – спектральна густина одиничної реалізації

– спектральна густина одиничної реалізації ![]() .

.

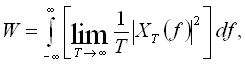

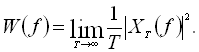

При збільшенні інтервалу ![]() енергія процесу на інтервалі необмежено наростає, а середня потужність прямує до певної границі:

енергія процесу на інтервалі необмежено наростає, а середня потужність прямує до певної границі:

де підінтегральна функція є спектральною густиною потужності даної реалізації випадкового процесу:

Досить часто цей вираз називають просто спектром потужності. Густина потужності є суттєвою, невід’ємною та парною функцією частоти. В загальному випадку густину потужності необхідно усереднювати за множиною реалізацій, але для ергодичних процесів допустимо усереднювати за однією тривалою в часі реалізацією.

Спектральна щільність будь-якої стаціонарної випадкової функції є невід’ємною функцією ![]() .

.

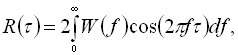

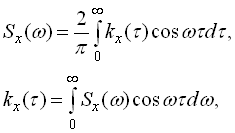

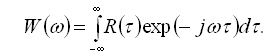

Спектральна щільність![]() і кореляційна функція

і кореляційна функція ![]() пов’язані перетворенням Фур’є. У дійсній формі вони мають вигляд

пов’язані перетворенням Фур’є. У дійсній формі вони мають вигляд

приймаючи, що ![]() отримаємо

отримаємо  .

.

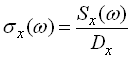

Нормованою спектральною щільністю ![]() називається відношення спектральної щільності до дисперсії випадкової функції

називається відношення спектральної щільності до дисперсії випадкової функції

.

.

Теорема Хінчина - Вінера

Розглянемо сигнал ![]() , який є однією реалізацією випадкового стаціонарного ергодичного процесу тривалістю

, який є однією реалізацією випадкового стаціонарного ергодичного процесу тривалістю ![]() . Для сигналу

. Для сигналу ![]() можна визначити спектр

можна визначити спектр ![]() . Якщо зсунути на

. Якщо зсунути на ![]() реалізацію процесу, то отримаємо спектр

реалізацію процесу, то отримаємо спектр ![]() . Для дійсних сигналів

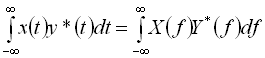

. Для дійсних сигналів ![]() рівність Парсеваля за енергією взаємодії двох сигналів

рівність Парсеваля за енергією взаємодії двох сигналів

може бути записана в такій формі:

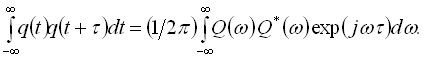

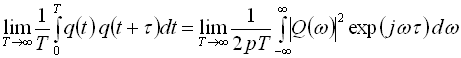

Поділимо обидві частини рівності на ![]() і перейдемо до границі при

і перейдемо до границі при ![]() , при цьому в її лівій частині побачимо вираз для функції кореляції, а в правій частині – перетворення Фур’є спектра потужності сигналу:

, при цьому в її лівій частині побачимо вираз для функції кореляції, а в правій частині – перетворення Фур’є спектра потужності сигналу:

,

,

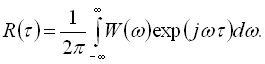

Звідси випливає, що кореляційна функція випадкового стаціонарного ергодичного процесу є зворотним перетворенням Фур’є його спектра потужності. Тому для спектра потужності випадкового процесу маємо пряме перетворення Фур’є:

В цьому і полягає зміст теореми Хінчина – Вінера. Функції ![]() та

та ![]() – дійсні та парні; в тригонометричній формі мають вигляд:

– дійсні та парні; в тригонометричній формі мають вигляд: