3.6 Елементи теорії статистичних рішень

Що таке – статистичне рішення? Як найпростіший приклад розглянемо ситуацію, у якій треба зіграти у таку гру:

- вам заплатять 2 долари, якщо підкинута монета впаде догори гербом;

- ви заплатите 1 долар, якщо вона впаде гербом униз.

Швидше за все, ви погодитеся зіграти, хоча розумієте степінь ризику. Ви усвідомлюєте, «знаєте» про рівно ймовірнісні появи герба і «обчислюєте» свій виграш 0.5∙2 – 0.5∙1 = +$0.5.

Ускладнимо цю гру. Ви бачите, що монета трохи вигнута і можливо буде падати частіше однією зі сторін. Тепер рішення грати або не грати як і раніше залежить від ймовірності виграшу, що не може бути заздалегідь (по-латинському – apriori) прийнятою рівною 0.5.

Людина, що знайома із статистикою, спробує оцінити цю ймовірність за допомогою дослідів, якщо, зазвичай, вони можливі і коштують не дуже дорого. Звідси виникає питання – скільки таких підкидань вам буде досить?

Нехай ви платите 5 центів за одне експериментальне кидання, а ставки у грі складають $2000 проти $1000. Швидше за все, ви погодитесь грати, заплативши порівняно невелику суму за 100..200 експериментальних кидків. Ви, напевно, будете вести підрахунок вдалих падінь і, якщо їх число складе 20 з 100, припините експеримент і зіграєте на ставку $2000 проти $1000, оскільки очікуваний виграш оцінюється у 0.8∙2000 + 0.2∙1000 – 100∙0.05 = $1795.

У наведених прикладах головним для прийняття рішення була ймовірність успішного результату падіння монети. У першому випадку – апріорна ймовірність, а у другому – апостеріорна. Таку інформацію прийнято називати даними про стан природи.

Наведені приклади мають безпосереднє відношення до сутності нашого предмета. І справді – під час системного керування доводиться приймати рішення в умовах, коли наслідки таких рішень заздалегідь вірогідно невідомі. При цьому питання: грати або не грати – не стоїть! «Грати» треба, тобто, треба керувати системою. Ви запитаєте – а як же заборона на експериментти? Відповідь можна дати таку – сама поведінка системи у звичайному її стані може розглядатися як експеримент, з якого для правильної організації збору та обробки інформації про поведінку системи можна чекати на одержання даних для з’ясування особливості системного підходу до розв’язання задач керування.

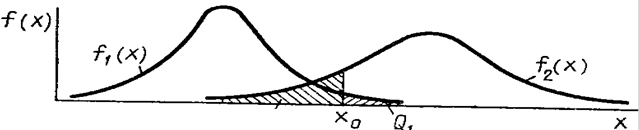

Для детальнішого розуміння теорії статистичних рішень розглянемо такий приклад. Нехай для характеристики об’єктів використовується ознака х, а уся їх сукупність розбита на два класи Ω1 і Ω2. При цьому, вважатимемо, що відомі описи цих класів, тобто відомі умовні щільності розподілу ймовірностей f1(x) і f2(x) значень ознаки об’єктів класів Ω1 і Ω2, а також апріорні ймовірності P(Ω1) і P(Ω2) появи об’єктів.

Нехай за результатами експерименту визначено значення ознаки х0 досліджуваного об’єкта (рис. 3.2).

Щоб прийняти рішення до якого класу віднести досліджуваний об’єкт, позначимо через х0 деяке доки ще невизначене значення ознаки х0, і домовимося про таке правило. Якщо значення ознаки задовольняє умові х0 > х0, то об’єкт відносимо до класу Ω2, а якщо задовольняється умова x0 ≤ х0, то до класу Ω1.

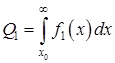

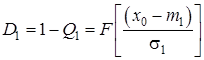

При цьому, якщо об’єкт відноситься до класу Ω1, а його вважають об’єктом класу Ω2, то це свідчить про помилку прийняття рішення – помилка першого роду, умовна ймовірність якої визначається за виразом:

, (3.17)

, (3.17)

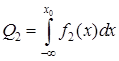

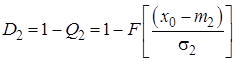

Відповідно термінології теорії статистичних рішень у цьому випадку помилково вибрана гіпотеза H2, у той час коли вірною є гіпотеза Н1. І навпаки, коли вірною є гіпотеза Н2, а віддана перевага гіпотезі H1, то вчинена помилка другого роду, умовна ймовірність якої визначається як:

,(3.18)

,(3.18)

Умовні ймовірності правильних рішень для випадків справедливості гіпотез H1 і H2 визначаються відповідно як:

,(3.19)

,(3.19)

,(3.20)

,(3.20)

де D1 – визначає розмірність іспитів,

D2 – їх потужність.

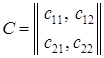

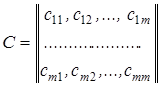

Міркування, якими слід керуватися під час вибору значення ознаки х0 (розбиття простору ознаки х на півпростори R1 і R2) повинні враховувати втрати, що пов’язані з правильними і помилковими рішеннями. Ці втрати зазвичай описують у вигляді платіжної матриці:

,(3.21)

,(3.21)

де с11 і с22, с12 і с21 – втрати, що пов’язані відповідно з правильними рішеннями і помилками першого і другого виду.

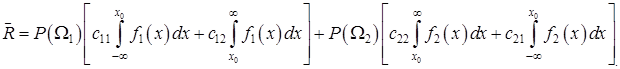

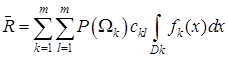

При цьому, у випадку багатократного застосування задачі прийняття рішень, середній ризик буде дорівнювати сумі втрат, що пов’язані з неправильними і правильними рішеннями, з урахуванням ймовірностей їх появи і апріорних ймовірностей появи об’єктів класів Ω1 і Ω2.

![]() .(3.22)

.(3.22)

Підставляючи у (3.22) вирази (3.19) і (3.20), отримаємо:

.(3.23)

.(3.23)

Оскільки прийняття рішень практично завжди є задачею багатократного застосування, значення х0 слід вибирати таким чином, щоб значення середнього ризику було мінімальним. Щоб визначити значення х0 , для якого середній ризик буде мінімальним, знайдемо його диференціал по х і прирівняємо отриману похідну до нуля, поклавши що х = х0.

,(3.24)

,(3.24)

звідки можна записати, що:

.(3.25)

.(3.25)

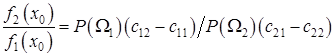

Відношення умовних щільностей розподілу f2(x)/f1(x) = l(х) називають коефіцієнтом або відношенням правдоподібності. При цьому, права частина виразу (3.25).

![]() ,(3.26)

,(3.26)

визначає порогове (критичне) значення коефіцієнту правдоподібності.

Значення х0 дозволяє оптимальним чином (з точки зору мінімуму середнього ризику) розбити простір значень ознаки х на області R1 і R3. Область R1 включає значення х ≤ х0, для яких λ(x) ≤ λ0, а область R2 – значення х > х0, для яких λ(x) > λ0. Тому, рішення про віднесення досліджуваного об’єкта до класу Ω1 слід приймати, якщо значення коефіцієнта правдоподібності менше або дорівнює його критичному значенню. Інакше, об’єкт слід віднести до класу Ω3.

У загальному випадку, коли число класів m > 2, а об’єкти описуються набором ознак xi,..., хN або вектором x = {xi, ..., хN}, відношення правдоподібності між класами Ωk і Ωl буде визначатися як:

λkl = fk(х) / fl(х), k,l = 1, ..., m,(3.27)

платіжна матриця має вигляд:

,(3.28)

,(3.28)

а середній ризик обчислюється за виразом:

,(3.29)

,(3.29)

З умови мінімуму значення середнього ризику рівняння границь у багатомірному просторі ознак між областями Dk і Dl, що відповідають класам Ωk і Ωl, буде визначатися як:

![]() , (3.30)

, (3.30)

При цьому, якщо покласти, що ckk = cll = 0, a ckl = clk = 1, то будемо мати:

P(Ωk) fk(x) – P(Ωl) fl(x) = 0,(3.31)

log P(Ωk) fk(x) / [P(Ωl) fl(x)] = 0.(3.32)